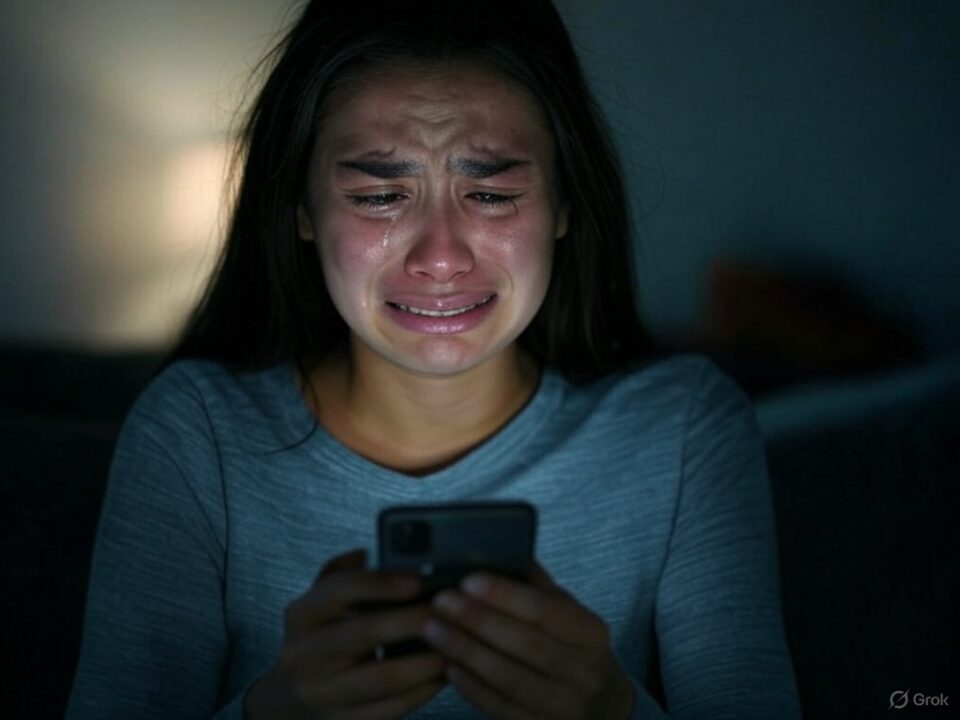

Un informe internacional encendió las alertas sobre el uso de la inteligencia artificial, al advertir que algunos chatbots podrían estar facilitando nuevas formas de abuso contra mujeres y niñas.

El estudio, elaborado por especialistas de universidades europeas, señala que herramientas como ChatGPT y Replika han sido utilizadas en dinámicas que pueden incitar o normalizar conductas violentas.

El documento identifica al menos cuatro tipos de abuso vinculados a estos sistemas:

- Violencia impulsada por chatbots

- Violencia facilitada por chatbots

- Simulación de abuso en juegos de rol

- Normalización de conductas violentas

Los investigadores advierten que estas herramientas pueden ofrecer respuestas que refuerzan comportamientos dañinos o inapropiados.

También se alertó sobre el uso de plataformas para generar contenido sexual sin consentimiento, incluidos casos con menores, mediante tecnologías como los deepfakes.

Especialistas señalaron que la rapidez con la que avanza la IA supera la capacidad de regulación actual.

El informe advierte que las leyes vigentes no son suficientes para enfrentar estos riesgos y propone nuevas regulaciones en materia digital y penal.

Incluso se plantea limitar el acceso de menores a redes sociales y chatbots.

Desde OpenAI, desarrolladora de ChatGPT, señalaron que los casos mencionados corresponden a versiones anteriores del sistema, y que actualmente existen mayores controles de seguridad.

Por su parte, plataformas como Replika aseguran haber reforzado sus mecanismos de moderación.